- 이주의경마 시간표

- 지난경마 AI복기

- AI 종합리포트

- AI Year Chart

- 경마 전문가리포트

- 말 승률/상금 Top 50

- 기수 승률 Top 20

- 조교사 승률 Top 20

- 마주 승률/상금 Top 20

- 대박 배당률 Top 100

- 대상경주 배당률 Top 50

- 마사회 평균 배당률

- 지역별 최고 배당률

- AI 경마시스템

X

X

분석 프로그램 용어 정의

분석 프로그램 용어 정의이전 장에서 제시했던 경마경주에 대한 내용과 데이터마이닝에 대하여 설명하고, 본 연구의 분석 방법에 대해 제시하고자 한다. 본 논문의 이해를 위해 경마의 용어와 분석에 사용된 용어를 설명한다.

● 데이터마이닝(Data Mining) : 자동화된 지능을 갖춘 데이터베이스 분석기법으로 90년대 초반부터 지식발견(KDD: Knowledge Discotery in Databases), 정보발견(Information Discovery), 정보수(Information Harversting)등의 이름으로도 소개되어 왔는데 일반적으로 데이터마이닝은 대량의 데이터로부터 새롭고 의미 있는 정보를 추출하여 의사결정에 활용하는 작업이라 정의된다.

“Mine”이란 의미는 ‘채광하다’ 즉, 거대한 더미 속에서 가치 있는 무언가를 캐낸다는 것으로 데이터마이닝이라는 것은 방대한 양의 데이터 속에서 쉽게 드러나지 않는 유용한 정보를 찾아내는 과정이라고 말할 수 있다.(장남식 외, 1999)

Peter는 데이터마이닝은 “ 많은 데이터 베이스로부터 지금까지 알려지지 않고, 유용한, 그리고 활용 가능한 정보를 추출하는 과정” 이라고 정의 하였다.(Peter, 1998)

Michael.J.A. Berry와 Gordon Linoff 는 “데이터마이닝은 관계, 패턴, 규칙 등을 발견하기 위해서 대용량의 데이터를 자동 또는 반자동적인 방법을 통하여 의미 있는 패턴이나 규칙을 찾아내는 것”이라 정의하다.(Michael.J.A. Berry와 Gordon Linoff, 1997)

● 회귀분석(Regression Analysis) : 회귀분석은 독립변수(Independent Variable)와 종속변수(Dependent Variable)간의 관계를 검증하여 독립변수가 종속변수에 미치는 영향력을 알아보거나, 독립변수의 변화에 따라 종속변수의 변화를 예측하기 위해서 사용되는 통계적 분석방법이다.

회귀분석은 독립변수의 개수에 따라 독립변수가 한 개인 경우는 단순 회귀분석(Simple Regression Analysis),둘 이상인 경우는 다중회귀분석(Multiple Regression Analysis)이라 한다.(김윤식, 2010)

● 단계적 회귀분석(Stepwise regression) : 하나의 반응변수(종속변수)를 설명할 수 있는 많은 설명변수(독립변수) 중에서 회귀모형에 사용할 변수를 축차적으로 하나씩 선택하거나 제거하여 가장 좋은 회귀모형을 선택하는 방법으로 전진선택법(forward selection method), 후진제거법(backward elimination method), 단계별선택법(stepwise selection method)등이 있다.

전진선택법은 반응변수와 상관관계가 가장 큰 설명변수부터 시작하여 하나씩 설명변수를 선택하는 방법이고, 후진제거법은 설명변수를 모두 포함한 완전모형(full model)에서 설명력이 가장 작은 설명변수부터 하나씩 설명변수를 제거하는 방법이다. 전진선택법을 사용할 때 한 변수가 선택되면 이미 선택된 변수 중 중요하지 않은 변수가 있을 수 있다.

이러한 단점을 보완하기 위해 전진선택법의 각 단계에서 이미 선택된 변수들의 중요도를 다시 검사하여 중요하지 않은 변수를 제거하는 방법을 단계별선택법이라 한다. 보통 단계별선택법에서 선택된 변수들을 사용한 회귀모형을 이용하는 방법을 단계적 회귀분석이라 한다.(한국교육 평가학회, 2004)

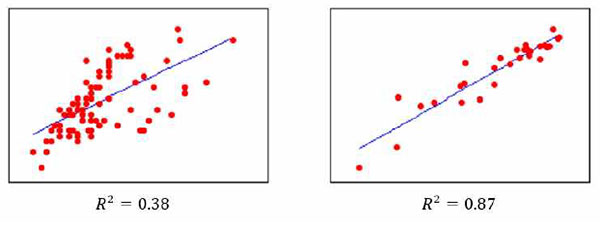

● R² : 하나 이상의 예측 변수와의 관계로 설명되는 반응 변수 변동의 백분율을 나타낸다. 일반적으로 R² 은 다중 회귀분석에서 결정계수 또는 다중결정계수라고도 하며, R² 값이 클수록 모형이 데이터를 더 잘 적합시키며 설명력이 좋은 모형이라고 할 수 있다.

그림 3.1에서 왼쪽 회귀 모형이 R² = 0.38로 변동의 38.0%를 설명하고, 오른쪽 회귀모형이 R² = 0.87로 변동의 87%를 설명한다. 회귀 모형에서 설명하는 변동이 많을수록 데이터 점이 적합 회귀선에 더 가깝게 된다.(Minitab Inc, 2010)

● 정규화(Normalization) : 어떤 대상을 일정한 규칙이나 기준에 따르는 정규적인 상태로 바꾸거나 비정상적인 대상을 정상적으로 되돌리는 과정을 뜻한다.(wikipedia Foundation Inc)